نوشته پسخ بنسون و عمر نوووسلسکی • ۱۸ مارس ۲۰۲۶

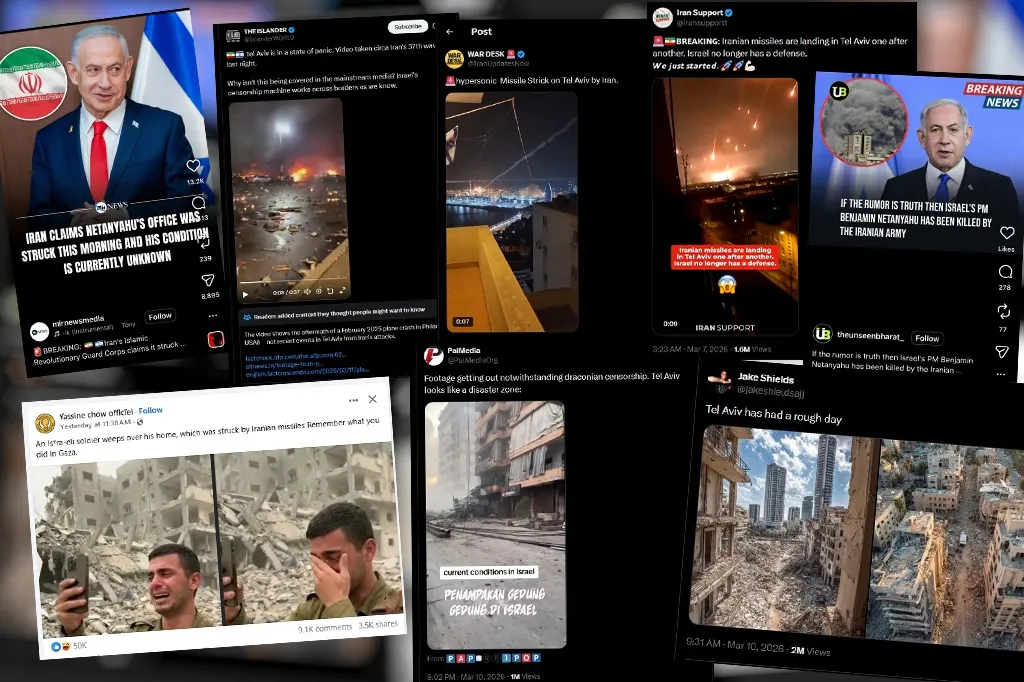

اورشلیم، ۱۸ مارس ۲۰۲۶ (تیپیاس-ایل) — جنگ با ایران باعث افزایش تصاویر جعلی در فضای آنلاین شده است، با ویدئوها و عکسهای تولید شده توسط هوش مصنوعی که ادعا میکنند حملات موشکی تلآویو را ویران کرده یا نیروهای آمریکایی توسط نیروهای ایرانی اسیر شدهاند.

شرکت اسرائیلی تشخیص اطلاعات نادرست سایبرا گزارش داد که دهها هزار حساب کاربری عمدتاً طرفدار ایران در تیکتاک، در دو هفته اول درگیری محتوایی را منتشر کردهاند که به ۱۴۵ میلیون بازدید رسیده است. یک ویدئوی قابل توجه که میلیونها بازدید در ایکس و تیکتاک دریافت کرد، ساختمانهای آپارتمانی تلآویو را در حال فرو ریختن زیر آتش موشک نشان میداد. چندین تصویر و ویدئو ادعا میکردند که آسمانخراش برج خلیفه دبی – بلندترین ساختمان جهان – در شعلههای آتش است.

هر دو مورد جعلی بودنشان اثبات شد. خبرگزاری فرانسه به اعوجاجهای آشکار در ویدئوی تلآویو اشاره کرد، در حالی که کارشناسان ناسازگاریهایی را در الگوهای دود و نورپردازی – در میان مشکلات دیگر – در تصاویر برج خلیفه یافتند. علاوه بر این، مردم تصاویر خود را منتشر کردند که تلآویو و برج خلیفه را عادی نشان میداد.

اخبار جعلی به نقطهای رسید که نخستوزیر اسرائیل ویدیویی از خود منتشر کرد که در حال سفارش قهوه در کافهای در اورشلیم بود تا شایعات اینترنتی مبنی بر مرگش را رد کند و تأیید کند که پنج انگشت دارد.

برای درک بهتر مقیاس و تأثیر این کمپینهای اطلاعات نادرست، تیپیاس-ایل با کارشناسان رسانه، جنگ روانی و تبلیغات صحبت کرد که اشاره کردند این تلاشها مقیاس، نمادگرایی و فوریت را برای دستکاری درک ترکیب میکنند.

جکی الکساندر، مدیر عامل ناظر رسانهای مستقر در اورشلیم، HonestReporting، گفت که تصاویر و ویدئوهای جعلی «وارد آگاهی کسانی میشوند که صرفاً نمیدانند. در عصر چرخههای خبری تولید شده توسط هوش مصنوعی، مردم دیگر نمیدانند چه چیزی را باور کنند، بنابراین هیچ چیز و همه چیز را باور میکنند.»

او افزود که تصاویر برای گمراه کردن مردم یا حتی تولید شده توسط هوش مصنوعی، نیازی به دراماتیک بودن ندارند.

الکساندر گفت: «برخی از فراگیرترین تصاویر یا ویدئوهای «جعلی» در واقع واقعی هستند که صرفاً (به عمد) برچسب اشتباه خوردهاند.»

به گفته دکتر ران شلایفر، مدرس ارشد دانشگاه آریل متخصص در جنگ روانی، هوش مصنوعی «چیزی را تغییر نداده است؛ فقط فرآیندها را کوتاهتر کرده است.» او توضیح داد که رسانههای اجتماعی و هوش مصنوعی چرخههای سریع پیامرسانی را امکانپذیر میکنند، از جمله پاسخدهندگان پولی، ایدئولوگها و رباتها، که توهم اجماع گسترده را ایجاد میکنند.

او افزود که این کمپینها از نیاز رسانههای اجتماعی به فوریت سوءاستفاده میکنند.

شلایفر توضیح داد: «پلتفرمها باید پر شوند. تا سالهای بسیار پیش، چهار بار در روز خبر وجود داشت، پس از آن هشت بار، و پس از آن، هر ساعت، و آنها باید با چیزی پر شوند. این را در کانالها و پلتفرمها و رسانهها و غیره ضرب کنید. بنابراین مردم در حرفه روابط عمومی درگیر هستند، که قبلاً برای ثروتمندان بود، و امروز همه آن را انجام میدهند.»

نوعم بننت، کارشناس رسانه، به تیپیاس-ایل گفت که کارتونها و تبلیغات بصری در جهان عرب اغلب اسرائیلیها را غیرانسانی جلوه میدهند و روایتهای تاریخی را معکوس میکنند، مانند به تصویر کشیدن غزه به عنوان آشویتس. او گفت که ظهور هوش مصنوعی این تأثیر را تشدید کرده و خط بین تصویرسازی و واقعیت را محو کرده است.

بننت گفت: «هوش مصنوعی تصاویری تولید میکند – موشکهایی که به ناوهای هواپیمابر اصابت میکنند یا تصاویری نمادین از امپریالیسم آمریکا – که واقعی به نظر میرسند و قدرت احساسی دارند.»

در محیطی که اطلاعات نادرست سریعتر از راستیآزمایی منتشر میشود، کارشناسان بر هوشیاری تأکید میکنند. شلایفر خواستار درک هر دو پویایی فناورانه و انسانی پشت این کمپینها شد.

او گفت: «آنچه جدید است، کانالی است که پیام از طریق آن منتقل میشود. قبلاً، شما به اعلامیهها و هواپیماها نیاز داشتید. امروز، همه چیز از طریق تلفن است.»

الکساندر به کاربران توصیه کرد که «محتوا را اسکرینشات بگیرند و به جای اشتراکگذاری اصلی، نظر خود را منتشر کنند و آن را گزارش دهند.»

او همچنین استفاده از عقل سلیم را توصیه کرد.

الکساندر با اشاره به تصویری دستکاری شده که رئیسجمهور اسرائیل ایتسحاک هرتزوگ را با جفری اپستین نشان میداد، تأکید کرد: «عکس نشان میداد که اپستین سلفی میگیرد – چیزی که در دهه ۱۹۹۰ وجود نداشت. بنابراین، آهسته باشید و به دنبال سرنخ باشید.